数据挖掘算法在大数据场景中的应用:以聚类分析为例

聚类分析是数据挖掘中的重要工具,广泛应用于各类问题的探索性分析中。在大数据场景下,聚类算法面临计算资源消耗、数据维度过高、噪声干扰等挑战,但通过数据采样、降维技术和并行计算等手段,可以有效地提升聚类效率和效果。随着大数据技术的发展,聚类算法将继续在数据分析中发挥重要作用,帮助企业和研究人员从海量数据中发现潜在的价值。

随着互联网和传感器技术的快速发展,数据的规模不断扩大,大数据技术成为了分析和处理海量信息的关键工具。在这一背景下,数据挖掘技术中的聚类分析作为一种重要的无监督学习方法,广泛应用于市场分析、客户细分、社交网络分析等领域。本文将详细介绍聚类分析算法的原理、数学模型和算法步骤,展示如何使用Python中的Scikit-learn库实现聚类分析,并探讨在大数据场景下聚类分析面临的挑战及解决策略。

一、聚类分析算法原理

聚类分析的目标是将数据集中的对象根据某种相似性度量划分成若干个簇(Cluster)。同一簇内的对象具有较高的相似性,而不同簇之间的对象则差异较大。聚类分析常用于发现数据中的潜在模式和结构,是数据挖掘中不可或缺的一部分。

1.1 K-Means算法

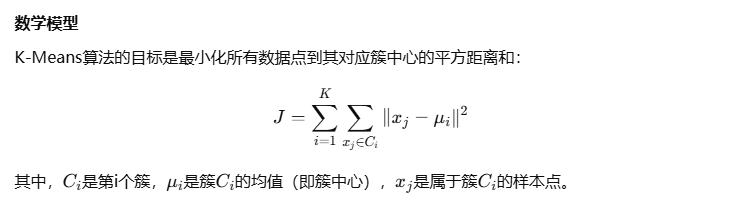

K-Means是一种基于距离的聚类算法,旨在通过最小化簇内的样本点与簇中心之间的距离来进行聚类。K-Means聚类属于划分型聚类算法,需要事先指定簇的数量K。

算法原理

K-Means算法的基本步骤如下:

- 初始化:随机选择K个数据点作为初始簇中心。

- 分配步骤:将每个数据点分配给距离其最近的簇中心。

- 更新步骤:计算每个簇的新的中心,即簇内所有数据点的均值。

- 迭代:重复步骤2和步骤3,直到簇中心不再变化或达到最大迭代次数。

数学模型

1.2 层次聚类(Hierarchical Clustering)

层次聚类是一种基于层次关系的聚类方法。它通过构建一个树状的层次结构来表示数据点之间的聚类关系。层次聚类可以分为两种类型:

- 凝聚型层次聚类(Agglomerative):自底向上,每次将最相似的两个簇合并,直到所有数据点都被归为一个簇。

- 分裂型层次聚类(Divisive):自顶向下,从整体数据集开始,逐步将簇拆分,直到达到预定的簇数。

层次聚类的主要优势是能够产生树状图(Dendrogram),便于理解数据的层次结构。

数学模型

层次聚类通过计算数据点之间的相似度来决定合并或分割簇。常见的相似度度量方法包括欧氏距离、曼哈顿距离等。最常见的聚类方式有:

- 单链法(Single Linkage):簇之间的距离为簇内最短的两个点之间的距离。

- 全链法(Complete Linkage):簇之间的距离为簇内最远的两个点之间的距离。

- 均值法(Average Linkage):簇之间的距离为簇内所有点的平均距离。

1.3 DBSCAN算法

DBSCAN(Density-Based Spatial Clustering of Applications with Noise)是一种基于密度的聚类方法,不要求用户事先指定簇的数量。它通过密度来判断数据点是否属于某个簇,并能够自动识别噪声点。

算法原理

DBSCAN通过以下两个参数进行控制:

- Eps:表示邻域的最大半径。

- MinPts:邻域内的最小点数。

DBSCAN的核心思想是,如果一个数据点的邻域内包含至少MinPts个点,则该点为核心点,并且这些点会被划归为同一簇;如果一个点不是核心点,但位于某个核心点的邻域内,则该点为边界点;如果一个点既不是核心点,也不是边界点,则被视为噪声点。

二、使用Scikit-learn实现聚类分析

Scikit-learn是Python中一个常用的机器学习库,提供了K-Means、层次聚类等多种聚类算法的实现。下面展示如何使用Scikit-learn实现K-Means和层次聚类算法,并对聚类结果进行可视化和评估。

2.1 K-Means聚类实现

from sklearn.cluster import KMeans

from sklearn.datasets import make_blobs

import matplotlib.pyplot as plt

# 生成一个模拟的数据集

X, y = make_blobs(n_samples=1000, centers=4, random_state=42)

# K-Means聚类

kmeans = KMeans(n_clusters=4)

kmeans.fit(X)

# 聚类结果

y_kmeans = kmeans.predict(X)

# 可视化聚类结果

plt.scatter(X[:, 0], X[:, 1], c=y_kmeans, s=50, cmap='viridis')

plt.scatter(kmeans.cluster_centers_[:, 0], kmeans.cluster_centers_[:, 1], c='red', s=200, alpha=0.5)

plt.title('K-Means Clustering')

plt.show()

2.2 层次聚类实现

from sklearn.cluster import AgglomerativeClustering

import matplotlib.pyplot as plt

# 使用相同的模拟数据

X, y = make_blobs(n_samples=1000, centers=4, random_state=42)

# 层次聚类

agg_clustering = AgglomerativeClustering(n_clusters=4)

y_agg = agg_clustering.fit_predict(X)

# 可视化聚类结果

plt.scatter(X[:, 0], X[:, 1], c=y_agg, s=50, cmap='viridis')

plt.title('Hierarchical Clustering')

plt.show()

三、聚类结果的评估与解释

聚类分析的评估与解释非常重要,可以帮助我们理解模型的有效性。常用的评估指标包括:

3.1 轮廓系数(Silhouette Score)

轮廓系数衡量数据点与其所属簇内点的紧密度以及与其他簇的分离度。值越接近1表示聚类效果越好,接近0则表示聚类效果较差,接近-1表示可能有错误的聚类。

from sklearn.metrics import silhouette_score

score = silhouette_score(X, y_kmeans)

print(f'Silhouette Score: {score}')

3.2 调整兰德指数(Adjusted Rand Index, ARI)

调整兰德指数衡量聚类结果与真实标签之间的相似度,值越大表示聚类效果越好。

from sklearn.metrics import adjusted_rand_score

ari = adjusted_rand_score(y, y_kmeans)

print(f'Adjusted Rand Index: {ari}')

四、大数据环境下的聚类分析挑战与解决策略

在大数据环境下,聚类分析面临着多个挑战,主要包括:

4.1 数据量过大导致的计算资源消耗

对于海量数据,传统的聚类算法(如K-Means)可能无法高效处理,尤其是在簇数K较大或数据维度较高时,计算资源的消耗会迅速增加。

解决策略:

- 数据采样:通过随机选择数据子集进行聚类,减少计算量,同时保持数据的代表性。

- 分布式计算:使用大数据处理平台(如Hadoop、Spark)进行并行计算,将任务分配到多个节点。

4.2 高维数据问题

高维数据可能导致距离度量失效,聚类效果下降,且计算复杂度急剧增加,尤其在K-Means等基于距离的算法中表现尤为明显。

解决策略:

- 降维技术:使用PCA(主成分分析)、t-SNE等降维方法减少数据的维度,同时保留数据的主要信息。

- 特征选择:通过选择与聚类任务相关的特征,减少冗余信息,提升聚类质量。

4.3 噪声和异常值

大规模数据集可能包含噪声和异常值,这些数据点可能会对聚类结果产生负面影响,尤其在密度型算法(如DBSCAN)中。

解决策略:

- 数据预处理:通过去噪、平滑等数据清洗方法去除异常值,提升聚类效果。

- 鲁棒聚类方法:选择适合处理噪声的聚类算法,如DBSCAN,它能够自动识别噪声点。

五、总结

聚类分析是数据挖掘中的重要工具,广泛应用于各类问题的探索性分析中。在大数据场景下,聚类算法面临计算资源消耗、数据维度过高、噪声干扰等挑战,但通过数据采样、降维技术和并行计算等手段,可以有效地提升聚类效率和效果。随着大数据技术的发展,聚类算法将继续在数据分析中发挥重要作用,帮助企业和研究人员从海量数据中发现潜在的价值。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)