【数据挖掘】心电图--建模与调参task04

目录目标一、逻辑回归1.1概念1.2回归于分类的区别1.3原理二、决策树模型2.1概念2.2决策树模型的优缺点三、集成模型集成方法四、模型评估方法五、代码示例目标学习在金融分控领域常用的机器学习模型学习机器学习模型的建模过程与调参过程一、逻辑回归优点训练速度较快,分类的时候,计算量仅仅只和特征的数目相关;简单易理解,模型的可解释性非常好,从特征的权重可以看到不同的特征对最后结果的影响;适合二分类问

目标

- 学习在金融分控领域常用的机器学习模型

- 学习机器学习模型的建模过程与调参过程

一、逻辑回归

优点

-

训练速度较快,分类的时候,计算量仅仅只和特征的数目相关;

-

简单易理解,模型的可解释性非常好,从特征的权重可以看到不同的特征对最后结果的影响;

-

适合二分类问题,不需要缩放输入特征;

-

内存资源占用小,只需要存储各个维度的特征值;

缺点

- 逻辑回归需要预先处理缺失值和异常值【可参考task3特征工程】;

- 不能用Logistic回归去解决非线性问题,因为Logistic的决策面是线性的;

- 对多重共线性数据较为敏感,且很难处理数据不平衡的问题;

- 准确率并不是很高,因为形式非常简单,很难去拟合数据的真实分布;

1.1概念

逻辑回归主要解决二分类问题,用来表示某件事情发生的可能性。

逻辑回归分析仅在线性回归分析的基础上套用了一个逻辑函数,用于预测二值型因变量,其在机器学习领域中有着特殊的地位,并且是计算广告学的核心。

1.2回归于分类的区别

回归所预测的目标量的取值是连续的(例如房屋的价格)

而分类所预测的目标变量的取值是离散的(例如判断肿瘤大小是否为恶性)

1.3原理

在之前的线性回归问题中,我们使用线性函数

用来拟合数据。

对于分类问题而言,我们要求其输出y的范围应该在(0,1)之间,而线性回归问题的假设函数 h(x) 输出值可能大于1或者小于0,显然,线性回归的假设函数已然不适用于分类问题我们需要重新找一个新的假设函数用来拟合分类问题的期望输出。

逻辑回归就是一种减小预测范围,将预测值限定为[0,1]间的一种回归模型,在线性回归的基础上引入了一个sigmoid函数,这个函数的性质,非常好的满足了:

函数的定义域x的输入是全体实数,而值域输出y总是[0,1],以一种概率的形式表示. 并且当x=0时,y=0.5, 这是决策边界。

二、决策树模型

2.1概念

决策树模型是一种基本的分类与回归方法,当决策树用于分类时称为分类树,用于回归时称为回归树。

决策树是一种树形结构,其中每个内部节点表示一个属性上的测试,每个分支代表一个测试输出,每个叶节点代表一种类别。

分类树(决策树)是一种十分常用的分类方法。他是一种监管学习,所谓监管学习就是给定一堆样本,每个样本都有一组属性和一个类别,这些类别是事先确定的,那么通过学习得到一个分类器,这个分类器能够对新出现的对象给出正确的分类。这样的机器学习就被称之为监督学习。

2.2决策树模型的优缺点

优点

-

简单直观,生成的决策树可以可视化展示

-

数据不需要预处理,不需要归一化,不需要处理缺失数据

-

既可以处理离散值,也可以处理连续值

缺点 -

决策树算法非常容易过拟合,导致泛化能力不强(可进行适当的剪枝)

-

采用的是贪心算法,容易得到局部最优解

三、集成模型集成方法

集成方法主要包括Bagging和Boosting,Bagging和Boosting都是将已有的分类或回归算法通过一定方式组合起来,形成一个更加强大的分类。

两种方法都是把若干个分类器整合为一个分类器的方法,只是整合的方式不一样,最终得到不一样的效果。常见的基于Baggin思想的集成模型有:随机森林、基于Boosting思想的集成模型有:Adaboost、GBDT、XgBoost、LightGBM等。

Baggin和Boosting的区别总结如下:

样本选择上: Bagging方法的训练集是从原始集中有放回的选取,所以从原始集中选出的各轮训练集之间是独立的;而Boosting方法需要每一轮的训练集不变,只是训练集中每个样本在分类器中的权重发生变化。而权值是根据上一轮的分类结果进行调整

样例权重上: Bagging方法使用均匀取样,所以每个样本的权重相等;而Boosting方法根据错误率不断调整样本的权值,错误率越大则权重越大

预测函数上: Bagging方法中所有预测函数的权重相等;而Boosting方法中每个弱分类器都有相应的权重,对于分类误差小的分类器会有更大的权重

并行计算上: Bagging方法中各个预测函数可以并行生成;而Boosting方法各个预测函数只能顺序生成,因为后一个模型参数需要前一轮模型的结果

四、模型评估方法

①留出法

留出法是直接将数据集D划分为两个互斥的集合,其中一个集合作为训练集S,另一个作为测试集T。需要注意的是在划分的时候要尽可能保证数据分布的一致性,即避免因数据划分过程引入额外的偏差而对最终结果产生影响。为了保证数据分布的一致性,通常我们采用分层采样的方式来对数据进行采样。

Tips: 通常,会将数据集D中大约2/3~4/5的样本作为训练集,其余的作为测试集。

②交叉验证法

k折交叉验证通常将数据集D分为k份,其中k-1份作为训练集,剩余的一份作为测试集,这样就可以获得k组训练/测试集,可以进行k次训练与测试,最终返回的是k个测试结果的均值。交叉验证中数据集的划分依然是依据分层采样的方式来进行。

对于交叉验证法,其k值的选取往往决定了评估结果的稳定性和保真性,通常k值选取10。

当k=1的时候,我们称之为留一法

③自助法

我们每次从数据集D中取一个样本作为训练集中的元素,然后把该样本放回,重复该行为m次,这样我们就可以得到大小为m的训练集,在这里面有的样本重复出现,有的样本则没有出现过,我们把那些没有出现过的样本作为测试集。

进行这样采样的原因是因为在D中约有36.8%的数据没有在训练集中出现过。留出法与交叉验证法都是使用分层采样的方式进行数据采样与划分,而自助法则是使用有放回重复采样的方式进行数据采样

五、代码示例

from sklearn.model_selection import KFold

# 分离数据集,方便进行交叉验证

X_train = data.drop(['id','label'], axis=1)

y_train = data['label']

# 5折交叉验证

folds = 5

seed = 2021

kf = KFold(n_splits=folds, shuffle=True, random_state=seed)

#因为树模型中没有f1-score评价指标,所以需要自定义评价指标,在模型迭代中返回验证集f1-score变化情况。

def f1_score_vali(preds, data_vali):

labels = data_vali.get_label()

preds = np.argmax(preds.reshape(4, -1), axis=0)

score_vali = f1_score(y_true=labels, y_pred=preds, average='macro')

return 'f1_score', score_vali, True

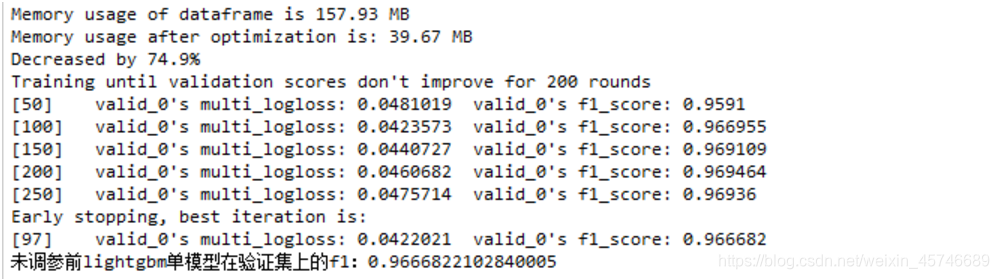

#使用Lightgbm进行建模

"""对训练集数据进行划分,分成训练集和验证集,并进行相应的操作"""

from sklearn.model_selection import train_test_split

import lightgbm as lgb

# 数据集划分

X_train_split, X_val, y_train_split, y_val = train_test_split(X_train, y_train, test_size=0.2)

train_matrix = lgb.Dataset(X_train_split, label=y_train_split)

valid_matrix = lgb.Dataset(X_val, label=y_val)

params = {

"learning_rate": 0.1,

"boosting": 'gbdt',

"lambda_l2": 0.1,

"max_depth": -1,

"num_leaves": 128,

"bagging_fraction": 0.8,

"feature_fraction": 0.8,

"metric": None,

"objective": "multiclass",

"num_class": 4,

"nthread": 10,

"verbose": -1,

}

"""使用训练集数据进行模型训练"""

model = lgb.train(params,

train_set=train_matrix,

valid_sets=valid_matrix,

num_boost_round=2000,

verbose_eval=50,

early_stopping_rounds=200,

feval=f1_score_vali)

#对验证集进行预测

val_pre_lgb = model.predict(X_val, num_iteration=model.best_iteration)

preds = np.argmax(val_pre_lgb, axis=1)

score = f1_score(y_true=y_val, y_pred=preds, average='macro')

print('未调参前lightgbm单模型在验证集上的f1:{}'.format(score))

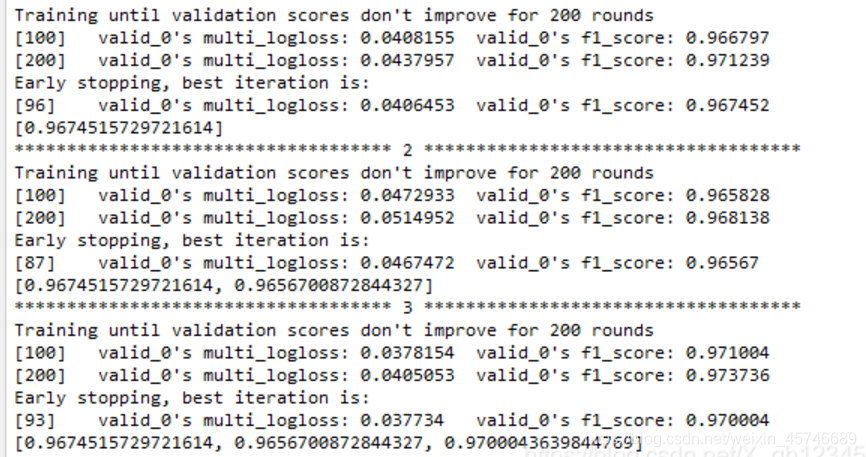

#更进一步的,使用5折交叉验证进行模型性能评估

"""使用lightgbm 5折交叉验证进行建模预测"""

cv_scores = []

for i, (train_index, valid_index) in enumerate(kf.split(X_train, y_train)):

print('************************************ {} ************************************'.format(str(i+1)))

X_train_split, y_train_split, X_val, y_val = X_train.iloc[train_index], y_train[train_index], X_train.iloc[valid_index], y_train[valid_index]

train_matrix = lgb.Dataset(X_train_split, label=y_train_split)

valid_matrix = lgb.Dataset(X_val, label=y_val)

params = {

"learning_rate": 0.1,

"boosting": 'gbdt',

"lambda_l2": 0.1,

"max_depth": -1,

"num_leaves": 128,

"bagging_fraction": 0.8,

"feature_fraction": 0.8,

"metric": None,

"objective": "multiclass",

"num_class": 4,

"nthread": 10,

"verbose": -1,

}

model = lgb.train(params,

train_set=train_matrix,

valid_sets=valid_matrix,

num_boost_round=2000,

verbose_eval=100,

early_stopping_rounds=200,

feval=f1_score_vali)

val_pred = model.predict(X_val, num_iteration=model.best_iteration)

val_pred = np.argmax(val_pred, axis=1)

cv_scores.append(f1_score(y_true=y_val, y_pred=val_pred, average='macro'))

print(cv_scores)

print("lgb_scotrainre_list:{}".format(cv_scores))

print("lgb_score_mean:{}".format(np.mean(cv_scores)))

print("lgb_score_std:{}".format(np.std(cv_scores)))

贪心调参

先使用当前对模型影响最大的参数进行调优,达到当前参数下的模型最优化,再使用对模型影响次之的参数进行调优,如此下去,直到所有的参数调整完毕。

这个方法的缺点就是可能会调到局部最优而不是全局最优,但是只需要一步一步的进行参数最优化调试即可,容易理解。

需要注意的是在树模型中参数调整的顺序,也就是各个参数对模型的影响程度,这里列举一下日常调参过程中常用的参数和调参顺序:

①:max_depth、num_leaves

②:min_data_in_leaf、min_child_weight

③:bagging_fraction、 feature_fraction、bagging_freq

④:reg_lambda、reg_alpha

⑤:min_split_gain

from sklearn.model_selection import cross_val_score

# 调objective

best_obj = dict()

for obj in objective:

model = LGBMRegressor(objective=obj)

"""预测并计算roc的相关指标"""

score = cross_val_score(model, X_train, y_train, cv=5, scoring='f1').mean()

best_obj[obj] = score

# num_leaves

best_leaves = dict()

for leaves in num_leaves:

model = LGBMRegressor(objective=min(best_obj.items(), key=lambda x:x[1])[0], num_leaves=leaves)

"""预测并计算roc的相关指标"""

score = cross_val_score(model, X_train, y_train, cv=5, scoring='f1').mean()

best_leaves[leaves] = score

# max_depth

best_depth = dict()

for depth in max_depth:

model = LGBMRegressor(objective=min(best_obj.items(), key=lambda x:x[1])[0],

num_leaves=min(best_leaves.items(), key=lambda x:x[1])[0],

max_depth=depth)

"""预测并计算roc的相关指标"""

score = cross_val_score(model, X_train, y_train, cv=5, scoring='f1').mean()

best_depth[depth] = score

"""

可依次将模型的参数通过上面的方式进行调整优化,并且通过可视化观察在每一个最优参数下模型的得分情况

"""

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)